|

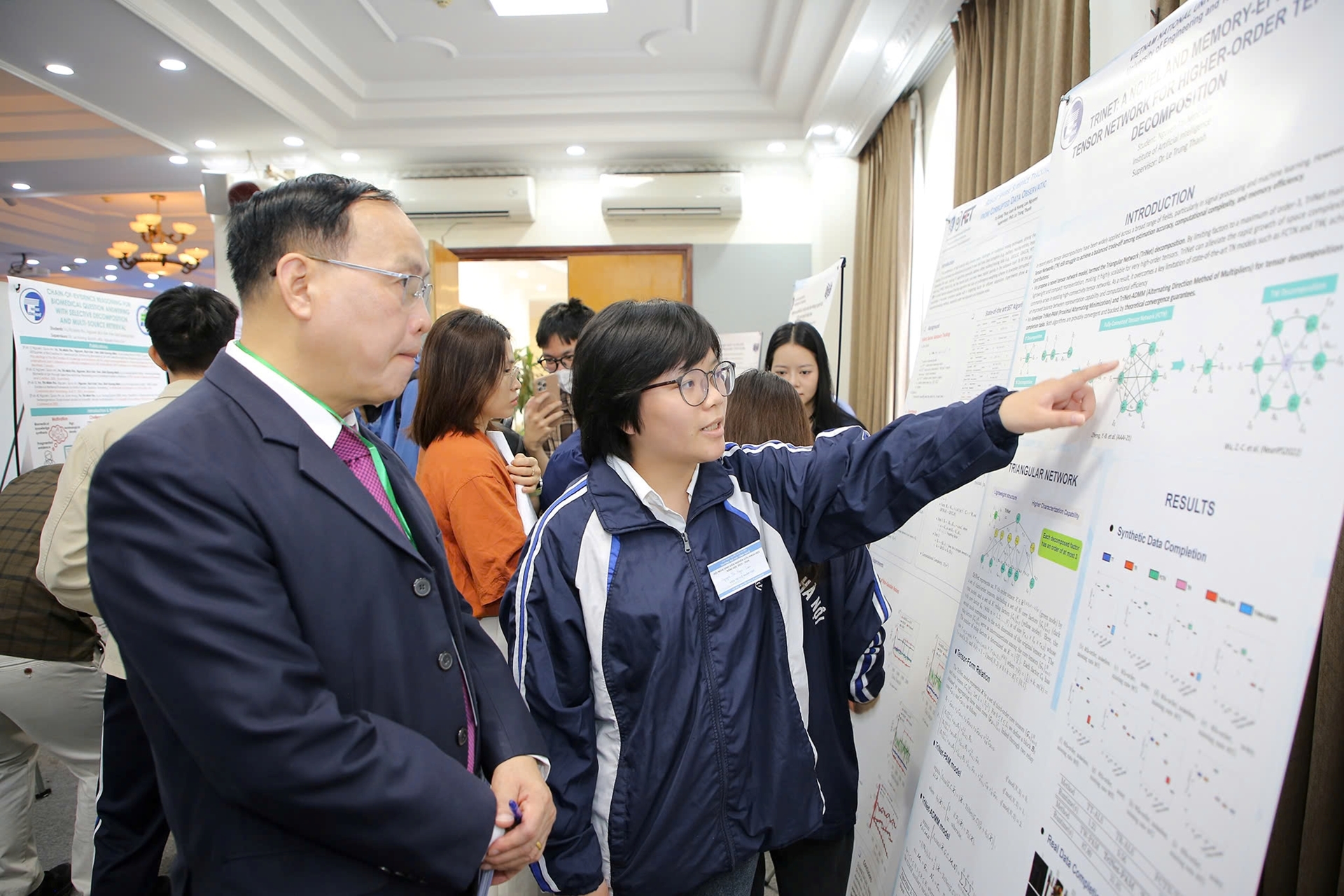

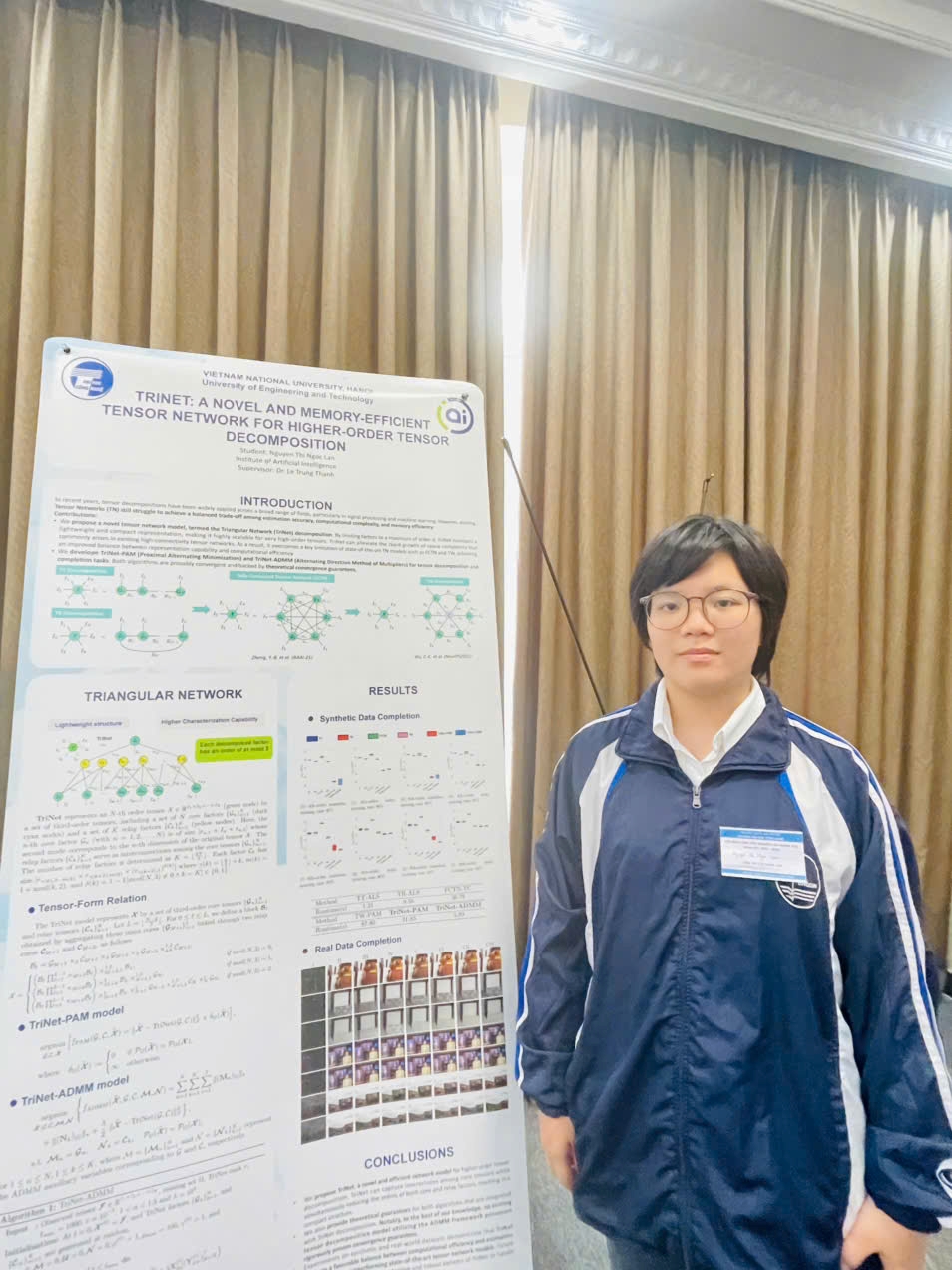

Đề tài “A Novel and Memory-Efficient Tensor Network for Higher-Order Tensor Decomposition” (Một mô hình mạng tensor mới với hiệu quả sử dụng bộ nhớ cao cho bài toán phân rã tensor bậc cao), do Nguyễn Thị Ngọc Lan, sinh viên năm 3 (K68A-AI2), Viện Trí tuệ nhân tạo, Trường ĐH Công nghệ, ĐHQGHN thực hiện dưới sự hướng dẫn của TS. Lê Trung Thành đã xuất sắc giành Giải Nhất sinh viên nghiên cứu khoa học cấp Trường năm 2026, được Hội đồng đánh giá cao về khả năng ứng dụng thực tiễn trong các bài toán dữ liệu lớn.

Khi dữ liệu “nổ chiều”: Tái cấu trúc dữ liệu là vấn đề cốt lõi

Trong thực tế, dữ liệu không chỉ là con số đơn lẻ mà tồn tại dưới dạng đa chiều: hình ảnh, video, tín hiệu y sinh, dữ liệu cảm biến, … Khi số chiều tăng lên, các mô hình truyền thống nhanh chóng rơi vào tình trạng quá tải bộ nhớ và tăng chi phí tính toán theo cấp số nhân – hiện tượng được gọi là “curse of dimensionality”.

Sinh ra trong chính bối cảnh đó, thay vì cố gắng “ép” dữ liệu vào các mô hình cũ, nhóm nghiên cứu chọn một hướng đi khác cho TriNet: thiết kế lại cách dữ liệu đa chiều được biểu diễn và phân rã ngay từ cấu trúc nền tảng.

Sinh viên Nguyễn Thị Ngọc Lan chia sẻ: Khi bắt đầu học về tensor, em nhận ra rằng vấn đề không chỉ nằm ở thuật toán, mà nằm ở cách chúng ta biểu diễn dữ liệu. Nếu biểu diễn không tối ưu, mọi thứ phía sau đều trở nên nặng nề.

Chính từ góc nhìn đó, TriNet được hình thành như một cách “tái cấu trúc” dữ liệu thay vì chỉ xử lý nó.

TriNet: Khi bài toán bộ nhớ được giải bằng tư duy cấu trúc

Điểm khác biệt cốt lõi của TriNet nằm ở cách tổ chức lại mạng tensor theo hướng tối ưu hóa biểu diễn toán học. Thay vì lưu trữ và xử lý toàn bộ không gian dữ liệu khổng lồ, mô hình tìm cách nén và phân rã dữ liệu thành các cấu trúc nhỏ hơn nhưng vẫn giữ được thông tin quan trọng.

Điều này giúp giảm đáng kể dung lượng bộ nhớ cần thiết mà vẫn đảm bảo độ chính xác của mô hình.

Nói cách khác, TriNet không chỉ “xử lý dữ liệu tốt hơn”, mà còn “hiểu dữ liệu theo cách gọn hơn”.

Chính sự cân bằng giữa độ chính xác – chi phí tính toán – hiệu quả bộ nhớ đã giúp mô hình trở nên đặc biệt trong các bài toán AI hiện đại, nơi tài nguyên phần cứng luôn là một giới hạn lớn.

Từ phòng thí nghiệm đến ứng dụng: khi lý thuyết chạm vào đời sống thực

Điểm đáng chú ý của TriNet không chỉ nằm ở lý thuyết, mà còn ở tiềm năng ứng dụng rất rộng.

Trong lĩnh vực y sinh, mô hình có thể hỗ trợ phân tích tín hiệu điện não (EEG), điện tim (ECG), giúp tách và làm sạch dữ liệu sinh học phức tạp. Trong thị giác máy tính, TriNet có thể được ứng dụng trong khôi phục ảnh, video độ phân giải cao hoặc loại bỏ nhiễu trong dữ liệu thực tế.

Ngoài ra, trong các hệ thống dữ liệu lớn, mô hình còn có khả năng hỗ trợ nén dữ liệu và giảm tải bộ nhớ, giúp các hệ thống AI hoạt động hiệu quả hơn trong điều kiện hạn chế tài nguyên.

Theo TS. Lê Trung Thành - giảng viên hướng dẫn đề tài: Điểm đáng giá của nghiên cứu này là sinh viên không chỉ dừng lại ở việc cải tiến thuật toán, mà đã nhìn thấy bài toán ứng dụng. TriNet có tiềm năng trở thành nền tảng cho nhiều hệ thống AI xử lý dữ liệu lớn trong tương lai.

|

Với Nguyễn Thị Ngọc Lan, hành trình nghiên cứu bắt đầu từ những ngày tiếp cận tensor – một khái niệm toán học phức tạp và trừu tượng. Những khó khăn ban đầu đến từ việc phải hiểu sâu cấu trúc toán học trước khi có thể chuyển hóa thành mô hình tính toán.

Tuy nhiên, chính quá trình đó lại giúp hình thành nền tảng để phát triển TriNet. “Có những giai đoạn em cảm thấy rất mơ hồ vì các phép toán tensor quá trừu tượng. Nhưng khi hiểu được bản chất, em bắt đầu nhìn thấy cách chúng có thể trở thành một hệ thống thực sự”, Ngọc Lan chia sẻ.

Khoảnh khắc đáng nhớ nhất là khi những kết quả nghiên cứu đầu tiên được hoàn thiện và được hội đồng khoa học chấp nhận – dấu mốc đánh dấu sự chuyển mình từ một ý tưởng học thuật sang một công trình có giá trị thực tiễn.

Mở rộng TriNet thành hệ sinh thái mô hình ứng dụng

Sau thành công tại giải thưởng cấp Trường, nhóm nghiên cứu tiếp tục phát triển TriNet theo hướng mở rộng ứng dụng.

Trong đó, TriNet Tracking hướng tới bài toán theo dõi và bóc tách tín hiệu theo thời gian thực, trong khi Robust TriNet tập trung vào xử lý dữ liệu nhiễu và ngoại lai. Các hướng mở rộng này nhằm đưa mô hình tiến gần hơn tới các bài toán thực tế trong AI, thị giác máy tính và phân tích dữ liệu lớn.

Về dài hạn, TriNet được kỳ vọng trở thành một nền tảng mô hình hóa dữ liệu đa chiều có thể tích hợp trong nhiều hệ thống trí tuệ nhân tạo thế hệ mới.

|

Từ một bài toán toán học tưởng chừng thuần lý thuyết, TriNet đã mở ra một cách tiếp cận mới trong xử lý dữ liệu đa chiều – nơi hiệu quả bộ nhớ, độ chính xác và khả năng ứng dụng được đặt trong cùng một hệ thống cân bằng. Thành công của đề tài không chỉ khẳng định năng lực nghiên cứu của sinh viên Trường ĐH Công nghệ, ĐHQGHN, mà còn góp phần thúc đẩy vai trò của ĐHQGHN trong lĩnh vực trí tuệ nhân tạo và khoa học dữ liệu.

>>> Tin bài liên quan:

- Drone gieo mầm rừng: Giải pháp công nghệ hỗ trợ phục hồi rừng cho cộng đồng vùng núi